ChatGPT或许能取代你的医生 —— 而且在关心你方面做得更好

没人期望从聊天机器人那里得到感性的友好话语。中规中矩的文字,当然可以,再加上一些虚构的事实和少许随意的种族歧视。

但正如我们所知,这些大型新型聊天机器人也可以生成对提示和问题的人类般回应。在最近的一项对决测试中,这种能力在本应是最为人类特性的活动之一上表现出惊人的优越性:充当医生的角色。

为了进行这项测试,来自加利福尼亚大学圣地亚哥分校的研究团队潜伏在r/AskDocs上,这是一个Reddit论坛,注册和验证的医疗保健专业人士在这里回答人们的医疗问题。研究人员从论坛上选择了近200个代表性的问题,从听起来愚蠢的问题("吞下了一根牙签,朋友说我会死掉")到可怕的问题("正常超声后一天流产?")。然后,他们将这些问题输入到聊天机器人ChatGPT的虚拟漩涡中,并让另一组医疗专家对来自AI和医生的答案进行盲评价。

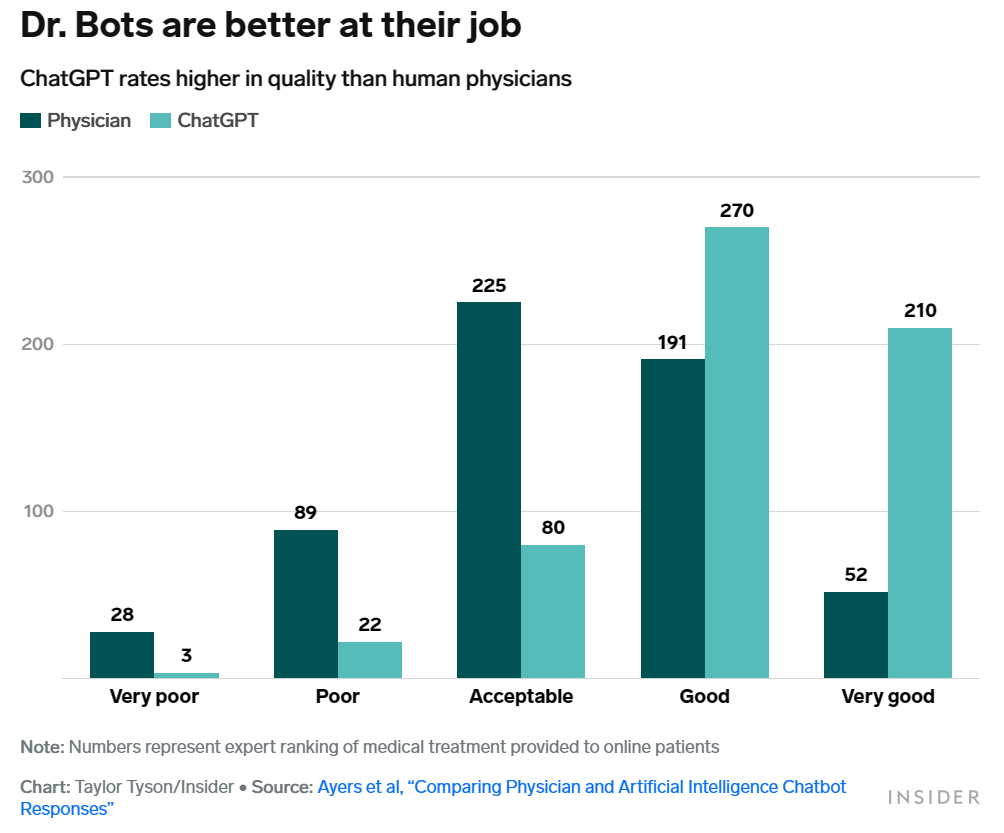

结果令人震惊。首先,ChatGPT在实用性方面远远超过了人类医生。几乎总是,聊天机器人的回答被评为可靠性是那些可怜的人类医生回答的三到四倍。更重要的是,这些机器人没有展示出他们在其他情况下经常表现出的虚构东西的倾向。

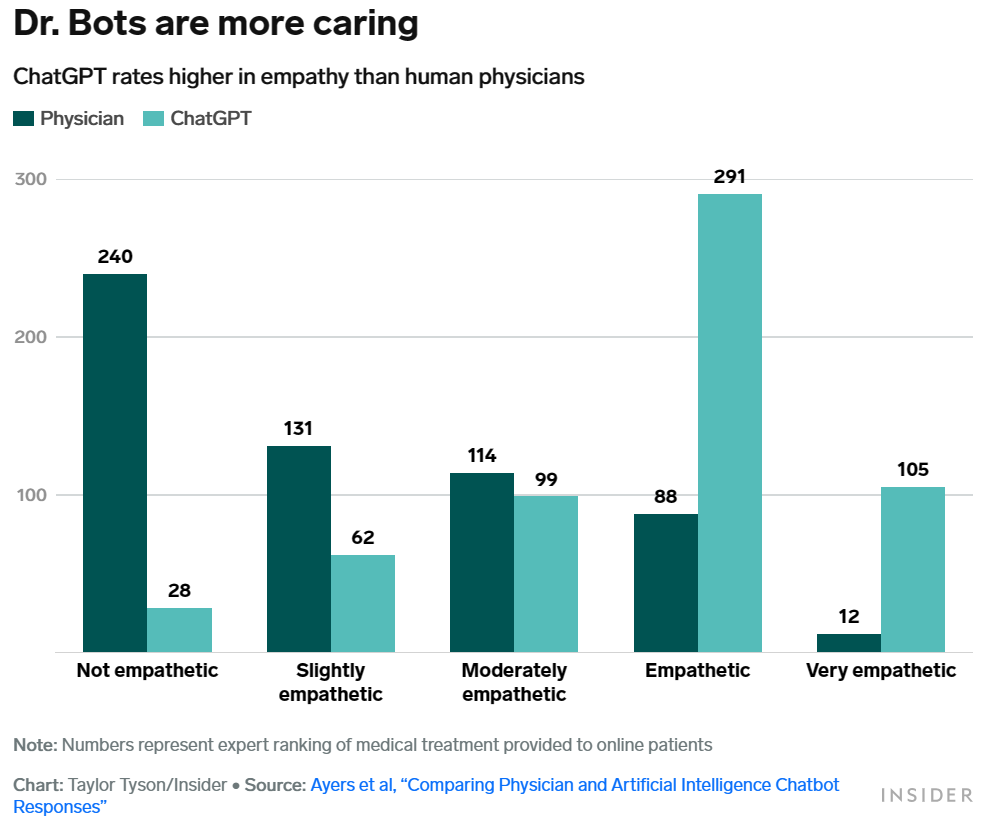

但最引人注目的部分在于:聊天机器人的回答平均被评为比人类的回答更具有七倍的共情。七倍!它们提供了您想从医生那里得到的:关心和情感连接。就好像没有情感的机器人Data先生想出了如何令人信服地模仿Crusher医生安慰病人的床边举止。

现在当然,对于展示同情心的医生,标准已经降低了。尽管如此,在风格和内容上,机器人在处理医疗问题方面似乎轻而易举,这预示着这些东西在实际的现实世界中可能有用途。我对于由大型语言模型驱动的AI机器人是否会彻底改变新闻业,甚至使互联网搜索变得更好感到怀疑。我想我对它们加速软件编码和电子表格分析的想法是开放的。但现在我认为,通过一些修补,聊天机器人可能会彻底改善人们与医疗保健提供者以及我们破碎的医疗工业体系之间的互动方式。

共情实验的目的不是要表明ChatGPT可以取代医生或护士。它是要表明聊天机器人在提供护理方面可能会有一定作用。我们的营利性医疗保健体系没有雇佣足够的医生和护士,而且它希望那些被雇佣的医生和护士能够越来越多地以流水线的方式对待更多的患者。没有人喜欢这种情况,除了变得富裕的人。

“人们与医疗保健脱节,他们感到绝望,” 加利福尼亚大学圣地亚哥分校的计算流行病学家约翰·艾尔斯(John Ayers)说,他是这篇新论文的主要作者。

因此,他们在r/AskDocs等论坛上寻找答案。"这是患者现在的做法。而医生并不是为此而签约的。" 医生机器人更关心 ChatGPT的共情评分高于人类医生

回答这些消息的压力变得非常大。COVID-19大流行加速了医生和患者之间的远程在线联系,甚至在大流行的第一年,研究表明医生每天工作时间几乎花了一个小时来处理他们的电子邮件收件箱。加上处理其他电子医疗记录技术,有些医生每天有一半的时间用于这些来回沟通。这足以使保险公司经常计费用于回复消息的时间,使其成为除面对面交流之外的额外收入来源。 之前的研究问患者和医生是否喜欢使用这些消息系统;艾尔斯研究了这个系统是否实际起作用。"我们使用了真实的消息,"他说。"以前从未有人这样做过。"基于互动质量,结果是明确的。“ChatGPT以压倒性的优势获胜,” 艾尔斯说。"这种东西可能已经准备好迎接主流时间了。

基于机器人最初的成功,艾尔斯准备看看它还能处理什么。"我们想要开始随机对照试验,评估患者的消息与患者的结果之间的关系," 他说,不仅仅是消息是否准确或有同情心,还包括它们是否有助于保持人们更健康或活得更长。"在某些情况下,一条消息可能会挽救患者的生命," 艾尔斯说。

鉴于高级AI系统已经相当擅长诊断,这些系统已经可以取得相当不错的诊断效果。它们经过高度训练,可以检测出特定的事物,比如肿瘤或败血症,利用特定的检测结果作为输入。但它们昂贵且难以构建。因此,医疗界正在将聊天机器人作为一种更便宜、更普遍的工具。许多公司正在开发应用程序,目标是从诊断疾病到处理繁琐的文件工作,这些工作不知何故变成了医生和患者的责任。如果你足够幸运有健康保险,你的保险公司可能已经为你准备了一些简单的聊天机器人,供你在通话前与之交谈。

如果问人们是否喜欢这个想法,他们大多会说不喜欢。最近,由皮尤研究中心进行的调查显示,60%的美国人表示,他们不希望由AI系统为他们进行诊断或提出治疗方法。但他们很可能还是会得到。不要告诉任何人我说过这话,但许多医疗保健工作者已经在某种程度上是有些程式化的——至少在最低级别的患者接触界面上是如此。你感觉不舒服,打电话给医疗建议护士;他们会问预设问题,以确定您是否应该前往急诊室或只需服用一颗泰诺。这被称为分诊。或者,如果你可以电子访问你的医疗记录,也许你会得到一套新的测试结果,然后你会给你的医生发电子邮件询问它们的含义。无论哪种方式,你都不会期望享受这些相遇。它们是例行公事。甚至可以说是机械的。

人工智能系统的知识库和处理能力支持的人类临床医生只会更好

嗯,你知道谁在机械方面很擅长吗?机器人!最近,来自哈佛大学的一个研究团队向三组人展示了数十种健康问题的描述:医生、没有医学培训的人以及ChatGPT。他们要求每个人(和每个-事物)诊断疾病,然后提出分诊建议。

非医生人类被允许进行互联网搜索——医疗人士戏称为"谷歌医生"。但即使在线辅助,未经训练的人在诊断方面表现糟糕。这并不令人震惊。但是,正如研究人员在最近的一份预印本中报告的那样——这意味着它尚未经过同行评审——聊天机器人在诊断方面的表现几乎与人类医生一样好(得分超过80%),而在分诊方面,ChatGPT的正确率略高于70%。与医生的91%相比,听起来确实不太好!这是一个通用聊天机器人,几乎与完全训练有素的医生一样出色。

现在想象一下,将这种技能集合与聊天机器人应该能够处理的一些琐碎而耗时的医疗任务结合起来——诸如安排预约、请求保险的事先授权,以及处理电子医疗记录。“这些是没有人进入医学领域来做的任务,它们是巨大的头痛,巨大的时间浪费,从身体上和情感上都令人疲惫,” 加利福尼亚大学旧金山分校的医学住院医师泰瓦·布伦德(Teva Brender)说。也许聊天机器人可以生成这种官僚流程的开端,还有所有发给患者的电子邮件。"医生可以快速浏览一下,然后说,'是的,这是对的',然后将其发送出去," 布伦德说。

这似乎是一个可能的情景。经过高度训练的聊天机器人将与医生、护士和医师助理一起工作,为那些需要护理的人提供更有同情心、更完整的回答。正如艾尔斯的团队在2019年写道的那样,人们如此渴望医疗帮助,以至于他们在r/STD子论坛上发布了他们自己的生殖器照片,希望得到准确的诊断。这真是太令人伤心了,也是对我们真正糟糕和不人道的医疗体系的惊人控诉。

在这种贫穷的体系中,人工智能可能真的是一种改进。谷歌健康AI部门负责人格雷格·科拉多(Greg Corrado)说:“一个由AI系统的知识库和处理能力支持的人类临床医生只会做得更好。“乔纳森·陈(Jonathan Chen),斯坦福大学医学院的一名医生,一直在研究AI系统。他说:"很可能,患者将寻求来自全天候可用的自动化系统的不完美的医疗建议,而不是等待数月才能约到人类专家的预约。

" 为了使这些基于AI的系统变得更好,许多人,包括艾尔斯的团队,现在正在开发经过精细调整的具有医学信息的小型语言模型。ChatGPT的吸引力在于它是一个从互联网上获取输入的通用工具。但这就是偏见和错误信息进入的方式。给这些医学聊天机器人访问人们的个人医疗记录,它们可以提供更具有精确定向的建议。"当这项技术获得电子健康记录的访问权限时,这将是真正的改变游戏规则," 艾尔斯说。

如果将来的医疗建议由AI驱动,并具有访问您的医疗记录的能力,如果让你感到担忧,我不怪你。在这里,坏的科幻结果相当的反乌托邦。经过多年的工作,美国食品和药物管理局仍然没有一个准备好监管医疗设备中的人工智能和机器学习的框架。有人将不得不解决围绕聊天机器人建议的所有责任问题,特别是当建议是错误的时候。医疗保健AI初创企业会希望推出最便宜、效果最显著的版本,但这不一定会带来最佳的患者结果。如果一家医疗公司设法将聊天机器人调整到最先进的医学水平,那么任何公司都可以用顶尖的医学知识来调整药物,或者调整为配方药物,甚至是反疫苗的荒谬理论。这些聊天机器人将会流露出危险的错误信息,既雄辩又富有同情心。

“这是最糟糕的情况,”谷歌健康人工智能部门负责人格雷格·科拉多(Greg Corrado)说道。"这不是让硅谷的人独自完成的事情。"这意味着与医疗专家一起开发这些系统,而不仅仅是医疗行业高管,以确保它们是私密和安全的,而且它们确实能够帮助人们。

虽然不会轻松,但可能是必要的。遗憾的是,我们的医疗系统并不是建立在为每个人提供体贴的人类护理员基础上的。在这种情况下,拥有能够帮助我们保持健康的机器人将会很好。如果它们能够同时模拟关心我们,甚至可能比人类医生做得更好,那么这仍然是一个令人愉悦的信息。