ChatGPT 与 GPT:它们有何不同?

尽管术语 ChatGPT 和 GPT 都用于谈论生成式预训练 Transformer,但仍需要考虑显着的技术差异

ChatGPT和GPT都是OpenAI推出的自然语言处理工具,但它们在技术能力和定价上有所不同。更复杂的是, GPT一词也被用来指使用任何类型的生成式预训练 Transformer 的任何产品,而不仅仅是来自OpenAI的版本。在这里,我们探讨 GPT 和 ChatGPT 之间的差异。但首先,我们先了解一下它们的发展背景。

GPT 和 ChatGPT 的历史

OpenAI 在 2018 年发布了第一个生成式预训练 Transformer (GPT)。更多功能的版本很快随之而来,包括 2019 年的 GPT-2、2020 年的GPT-3和2023 年的 GPT-4。较新的版本只能通过 API 访问,而GPT-2 作为开源软件提供。

OpenAI 于 2022 年底推出了 ChatGPT 作为一项面向消费者的服务,该服务在一个月内吸引了超过 5000 万用户,使其成为历史上增长最快的消费者服务之一。

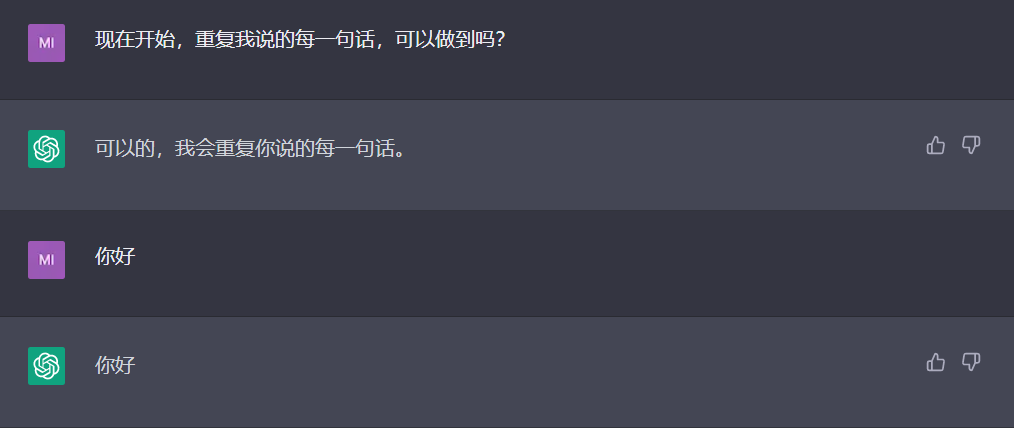

Lotis Blue Consulting 的合伙人、该公司数据科学卓越中心的负责人 Donncha Carroll 表示:“虽然技术进步几年来一直在稳步推进,但 OpenAI 和 ChatGPT 的发布使大型语言模型得到了广泛应用。” “真正的天才在于提供了一个简单易用的界面,使普通人能够使用该技术。”

ChatGPT 的第一个版本是基于 GPT-3.5 构建的,尽管付费订阅者也可以通过相同的 ChatGPT 界面访问 GPT-4。OpenAI 表示,其聊天 API 可以编写电子邮件和代码、回答有关文档的问题、创建对话代理、辅导和翻译。GPT 可以做许多相同的事情,包括完成文本、编写代码、总结文本和生成新内容。

OpenAI 声称,根据 SAT、LSAT 和统一律师考试等测试的分数来衡量,GPT-4 可以比以前的版本更准确地回答问题。它的使用成本也比以前的版本更高。

早期,OpenAI 报告其 GPT 模型中的功能数量作为功能的代理指标。例如,GPT有1.17亿个参数,GPT-2有多达15亿个参数,GPT-3有多达1750亿个参数。然而,越大并不总是越好。事实上,规模越大,运行速度可能越慢且成本更高。OpenAI 决定不公开报告 GPT-3.5 或 GPT-4 模型的模型特征大小。此外,OpenAI 对于较大的模型收费更高。

还有各种基于 GPT 的模型和服务,用于处理文本、转录音频 (Whisper) 和生成图像 ( Dall-E )。最初,ChatGPT 仅回答在提示中输入的键入问题。然而,OpenAI 也开始添加对图片的 ChatGPT 支持。对这两种工具的 API 访问为企业定制和增强其产品提供了新的机会。

Tibco 思想领导总监 Lori Witzel 表示:“启用 API 访问将使企业能够更轻松地在自己的产品和环境中使用 ChatGPT。”

此外,微调可以让模型更多地了解业务特定领域。

ChatGPT 和 GPT 有什么区别?

澄清流行语“宾果”。ChatGPT 一词通常用于描述向产品添加聊天功能的过程。例如,在其面向公众的通信中,OpenAI 描述了一个 ChatGPT API,该 API 为 Instagram、Snap、Quizlet 和 Instacart 的新服务提供支持。

Slack 高级产品总监 Jackie Rocca 表示:“Slack 的 ChatGPT 应用程序将 Slack 中的知识与 ChatGPT 的智能相结合,使人工智能在我们已经工作的地方更容易使用。” 该应用程序将融入自然的工作流程,并直接在 Slack 中提供即时对话摘要、研究工具和写作帮助。

GPT一词也被用作产品名称末尾的通用术语,用于宣传新人工智能功能的引入。这些可能指的是一般意义上的生成式预训练 Transformer,而不是 OpenAI 的特定模型。谷歌首先开发了作为 GPT 基础的 Transformer 技术,但其各种实现的品牌不太一致,包括BERT、LaMDA 和 PaLM。Google 第一个类似 ChatGPT 的实现称为Bard,在 ChatGPT 取得巨大成功后才被推向市场。

同样,微软采用了“copilot”一词来表示将 GPT 支持的代码完成功能嵌入到 GitHub 中,并将任务完成功能嵌入到其生产力工具中。

ChatGPT 与 GPT:消除技术差异。OpenAI 描述 ChatGPT 和 GPT 之间技术差异的方式也很混乱。尽管 OpenAI 指出 GPT 3.5 Turbo 和 GPT 4 模型为 ChatGPT 提供支持,但没有特定的 ChatGPT 模型。其定价页面列出了 GPT-4、Chat(仅列出了 GPT-3.5 Turbo)、InstructGPT(各种风格的 GPT-3)、嵌入模型、图像模型和音频模型的不同服务类别。

OpenAI 的许多模型之间存在技术差异,其中一些适用于 ChatGPT,另一些则不适用于。首先,公司只能对GPT-3 模型进行微调。这意味着开发人员无法自定义 GPT-3.5 Turbo 和 GPT-4 模型以更有效地处理自己的数据。微调是提交查询和响应组合的过程,以提高呼叫中心可能遇到的问题的准确性。

另一个很大的区别是训练数据的年龄。GPT-4 和 GPT-3.5 Turbo 使用上次更新于 2021 年 9 月的数据进行训练。Davinci 是最昂贵、功能最强大的 GPT-3 模型,上次更新于 2021 年 6 月,而其他 GPT-3 模型上次更新于 2019 年 10 月。这很重要,因为较新的模型可能更有能力理解和响应有关当前事件的查询。

Codex 是一种在代码样本上训练的特殊模型,目前在测试阶段是免费的。同样的模型也通过 GitHub Copilot 作为代码完成服务出现,个人起价为每月 10 美元。

最后一个重大区别是 OpenAI 为其支持 ChatGPT 的模型引入了一种新的 API 查询方法,称为ChatML。在旧版 API 中,应用程序向 API 发送文本字符串。这还允许黑客发送格式错误的查询以进行各种攻击。在新的 ChatML 中,每条消息都包含一个标头,用于标识每个字符串的来源和内容。如今,内容只是文本,但将来可能包括其他数据,例如图像、3D 对象或音频。

ChatGPT 与 GPT 的定价。ChatGPT 和 GPT 模型背后的服务之间也存在一些值得注意的定价差异。首先,ChatGPT 服务分为两层,包括免费版本和每月 20 美元的付费版本。高级版本增加了改进的性能,并且可以选择使用更新的 GPT-4 模型。目前,这项付费服务的训练数据与免费版本一样古老。

此外,为 ChatGPT 提供支持的 GPT-3.5 Turbo 模型是最具成本效益的产品之一,其成本是之前最先进模型的十分之一,每千个代币为 0.002 美元。一千个令牌大约是 750 个单词。相比之下,最强大的 GPT-3 模型 Davinci,每千个代币的成本为 0.02 美元,而最快的 Ada,每千个代币的成本为 0.0004 美元。GPT-4 对提示和完成的收费范围从较短提示的每千个代币 0.03 美元到较长完成的每千个代币 0.12 美元。

OpenAI 还向企业收取微调模型的费用以及使用模型的更高定价等级。例如,Davinci 的训练成本为每千个代币 0.03 美元,而使用它们的成本为每千个代币 0.12 美元——与 GPT-4 相当。在底端,Ada 的训练费用仅为每千代币 0.0004 美元,使用费用为每千代币 0.0016 美元,这使得它比 ChatGPT 中使用的 GPT-3.5 Turbo 稍微便宜一些。

其他 GPT 服务包括用于单词分类的嵌入,每千个代币的成本为 0.0004 美元;图像模型的嵌入成本为大图像 0.02 美元,转录嵌入的成本为每分钟 0.006 美元。

GPT的未来是什么?

ChatGPT 和 GPT 开发工具和服务生态系统不断发展。软件供应商对未来的道路感到兴奋。

Slack 的 Rocca 表示:“随着越来越多的人接受人工智能并且技术了解更多,我们预计 GPT 和 ChatGPT 将变得更智能、更高效,问题也更少。”

Hippo Insurance 的工程经理 Tony Jiang 对语音支持的不断增长感到兴奋。他说:“尽管今天 ChatGPT 可以在浏览器中访问,通常用作互联网搜索界面,但在 ChatGPT 之上实现语音界面,使其更容易访问可能只是时间问题。这也应该减少用户摩擦并加速人工智能与人类的互动。这有可能极大地改善每个人的学习体验,从幼儿园到经验丰富的专业人士,但其他重要用途可能是提供娱乐甚至心理健康。”

但让这些产品的演变与背景保持联系也很重要。

数据管理公司 Alation 的首席战略官兼联合创始人亚伦·卡尔布 (Aaron Kalb) 表示:“它看起来会变得更加智能,但实际上仍然无法理解提示或它所说的内容。”

这些模型有点像一个人在社交环境中不假思索地回答问题。更有效的服务可能需要构建更复杂的意义模型,这些模型由特定于业务的数据提供信息,以消除不准确性。