Transformer应用之情感分析 - Transformer教程

在这个信息爆炸的时代,情感分析已经成为一个至关重要的工具。无论是企业想要了解客户的反馈,还是研究人员试图分析社交媒体上的情感趋势,情感分析都能提供宝贵的洞见。而在众多情感分析技术中,Transformer模型以其强大的性能和灵活性脱颖而出。今天,我们就来聊聊Transformer模型在情感分析中的应用。

什么是Transformer模型?

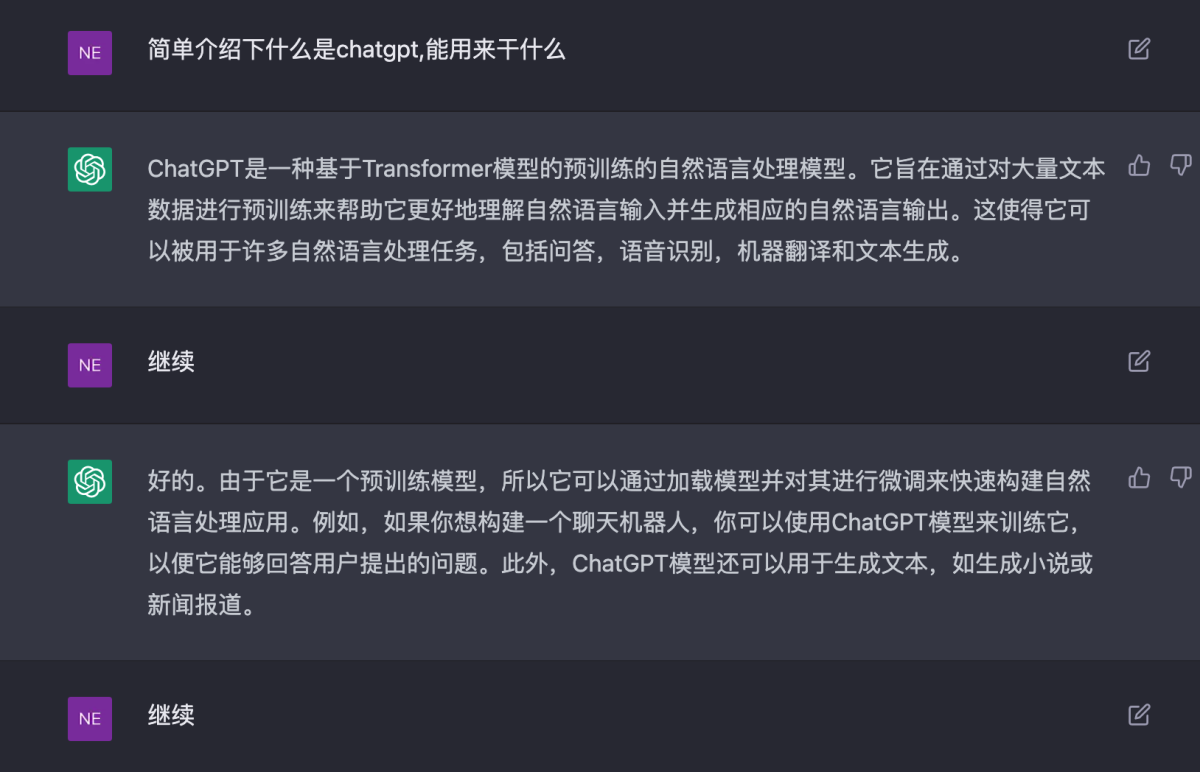

Transformer模型是一种基于神经网络的模型,它在自然语言处理(NLP)任务中表现出色。与传统的递归神经网络(RNN)不同,Transformer模型采用了一种叫做“自注意力机制”(Self-Attention Mechanism)的技术。这种机制允许模型在处理每一个词语时,能够同时关注句子中所有其他词语,从而捕捉更复杂和全局的语义关系。

情感分析的基本概念

情感分析,也被称为意见挖掘,是一种通过分析文本数据来识别和提取其中所表达的情感的技术。情感通常分为三大类:正面情感、负面情感和中性情感。例如,客户评价中的“这款产品真棒!”可以被识别为正面情感,而“我对这次服务非常失望”则是负面情感。

Transformer模型在情感分析中的优势

Transformer模型在情感分析中有诸多优势:

- 处理长文本的能力:自注意力机制使Transformer能够有效地处理长文本,捕捉上下文中的长距离依赖关系。

- 并行处理:相比于RNN需要逐词处理,Transformer可以并行处理整句话,大大提高了训练和推理速度。

- 强大的预训练模型:基于Transformer的预训练模型(如BERT、GPT-3)已经在海量数据上进行训练,可以很好地迁移到情感分析任务中。

Transformer模型在情感分析中的应用实例

让我们通过一个具体的例子来了解Transformer模型在情感分析中的应用。

准备数据

首先,我们需要准备一份情感分析的数据集。这里,我们使用一个包含客户评价的数据集。每条评价都有对应的情感标签(正面、负面或中性)。

数据预处理

数据预处理是非常重要的一步。我们需要将文本数据转换为模型可以处理的格式。具体来说,我们需要进行以下几步:

- 文本清洗:移除无用的字符、标点符号以及停用词。

- 分词:将文本分割成单词或词组。

- 词嵌入:将单词转换为向量表示,以便模型能够处理。

模型训练

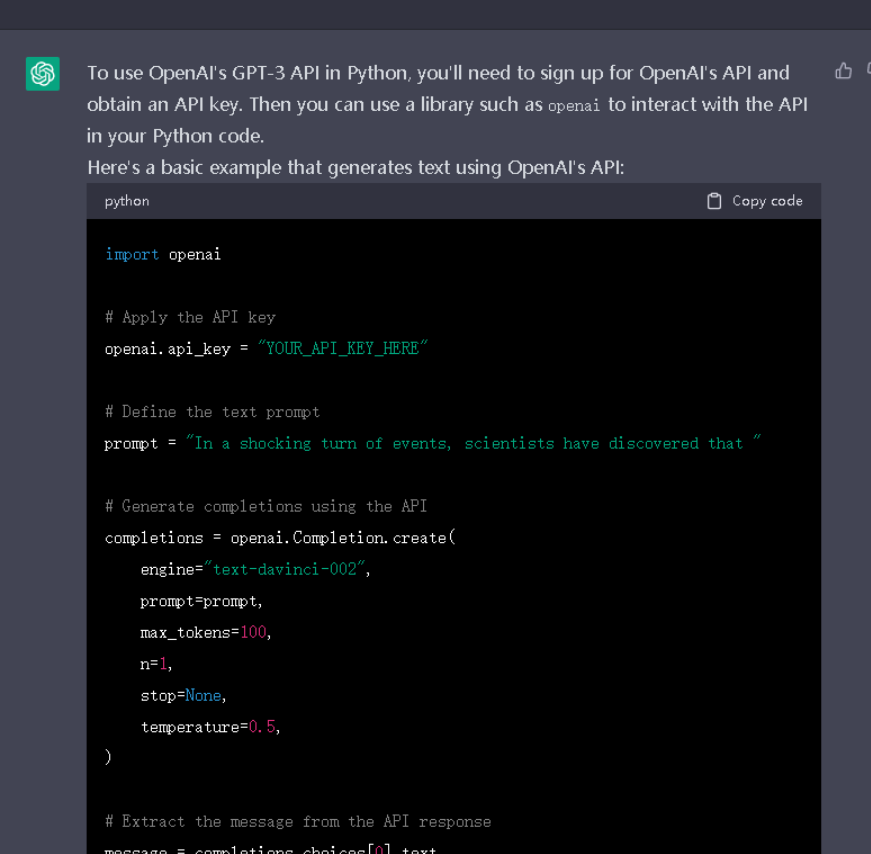

接下来,我们使用预训练的BERT模型进行微调。具体步骤如下:

- 加载预训练模型:我们可以使用Hugging Face提供的Transformers库来加载预训练的BERT模型。

- 微调模型:在我们的情感分析数据集上进行模型微调。这里,我们使用交叉熵损失函数来优化模型。

- 模型评估:在验证集上评估模型的性能,查看准确率、精确率、召回率等指标。

模型预测

训练完成后,我们可以使用模型进行情感预测。给定一条新的客户评价,模型可以预测其情感类别。我们还可以使用可视化工具来展示模型的注意力机制,帮助我们理解模型是如何做出预测的。

情感分析的实际应用

Transformer模型在情感分析中的应用非常广泛。以下是几个实际应用场景:

- 客户反馈分析:企业可以使用情感分析来分析客户反馈,了解客户的满意度和痛点,从而改进产品和服务。

- 舆情监控:政府和组织可以使用情感分析来监控社交媒体上的舆情,及时发现和应对潜在的危机。

- 市场调研:通过分析消费者对产品的评价和讨论,企业可以获取市场洞察,指导产品开发和营销策略。

总结

Transformer模型在情感分析中的应用展现了其强大的能力和广泛的前景。通过自注意力机制和预训练模型,Transformer不仅能够处理复杂的文本数据,还能提供高效准确的情感预测。无论是企业、研究人员还是政府组织,都可以从中受益,获取更深入的洞察。

在未来,随着NLP技术的不断发展和数据量的增加,Transformer模型在情感分析中的应用将会越来越广泛。希望这篇文章能帮助你更好地理解Transformer模型及其在情感分析中的应用。如果你对这个领域感兴趣,不妨亲自尝试一下,用Transformer模型来分析你身边的文本数据吧!

闪电发卡ChatGPT产品推荐:ChatGPT独享账号

ChatGPT Plus 4.0独享共享账号购买代充

ChatGPT APIKey 3.5和4.0购买充值(直连+转发)

ChatGPT Plus国内镜像(逆向版)

ChatGPT国内版(AIChat)

客服微信:1、chatgptpf 2、chatgptgm 3、businesstalent