Transformer的模型的扩展与应用领域的拓展 - Transformer教程

在如今的人工智能领域,Transformer模型已经成为了众多研究和应用的焦点。从自然语言处理到计算机视觉,Transformer模型的扩展与应用领域的拓展带来了无数的可能性。今天,我们就来聊聊Transformer模型的扩展以及它在不同领域的广泛应用。

首先,我们先来了解一下什么是Transformer模型。Transformer模型由Vaswani等人在2017年提出,它是为了解决自然语言处理(NLP)中的序列到序列问题。传统的RNN(循环神经网络)在处理长序列时效率低下,而Transformer通过自注意力机制(Self-Attention Mechanism)成功地解决了这一问题。自注意力机制使得模型能够在计算时并行化,极大地提升了计算效率。

在原始的Transformer模型中,有两个主要的部分:编码器(Encoder)和解码器(Decoder)。编码器负责将输入序列转换成一个固定长度的向量表示,而解码器则将这个向量表示转换成输出序列。自注意力机制在这个过程中起到了关键作用,它能够捕捉到序列中任意两个位置之间的依赖关系。

随着时间的推移,研究人员对Transformer模型进行了各种扩展和改进。最著名的改进之一是BERT(Bidirectional Encoder Representations from Transformers),它是一种双向Transformer模型。与传统的Transformer不同,BERT在训练时不仅考虑了左到右的上下文信息,还考虑了右到左的上下文信息,从而在理解文本的语义上有了更大的提升。BERT在多个NLP任务上取得了显著的效果,成为了NLP领域的一个里程碑。

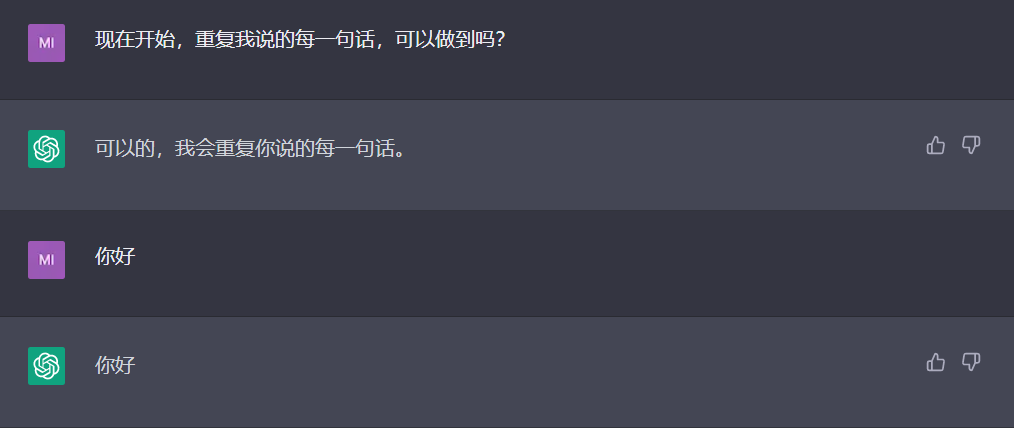

除了BERT,另一种重要的改进是GPT(Generative Pre-trained Transformer)系列模型。GPT是由OpenAI提出的,它专注于生成式任务。与BERT不同,GPT模型采用了单向的注意力机制,即只考虑从左到右的上下文信息。GPT系列模型在文本生成任务上表现出色,特别是在对话生成、文本补全等方面。

Transformer模型不仅在NLP领域取得了巨大成功,它在计算机视觉领域也展现了强大的潜力。例如,ViT(Vision Transformer)模型将Transformer应用于图像分类任务中。传统的卷积神经网络(CNN)在处理图像时表现优秀,但随着图像分辨率的提高,计算量也急剧增加。ViT通过将图像切分成若干小块,每个小块视作一个“词”,然后将这些“词”输入到Transformer模型中进行处理。这样,ViT不仅能够捕捉到图像中局部的细节,还能有效地整合全局信息。

除了图像分类,Transformer在其他计算机视觉任务中也有广泛应用。例如,在图像生成领域,DALL·E模型利用Transformer生成高质量的图像;在目标检测和分割任务中,DETR(Detection Transformer)模型通过自注意力机制捕捉图像中的目标位置,取得了与传统方法相媲美的效果。

Transformer的扩展不仅局限于NLP和计算机视觉领域,它在其他领域也展现了强大的应用潜力。例如,在推荐系统中,Transformer可以通过分析用户的行为序列,精准地预测用户的兴趣和需求;在时间序列分析中,Transformer通过自注意力机制捕捉数据中的长程依赖关系,提升了预测的准确性。

此外,Transformer还在生物信息学、语音识别等领域有广泛的应用。在生物信息学中,Transformer模型被用于蛋白质结构预测和基因序列分析,取得了显著的成果;在语音识别中,Transformer通过自注意力机制捕捉语音信号中的复杂模式,实现了更高的识别准确率。

总结一下,Transformer模型作为一种强大的神经网络结构,通过自注意力机制解决了许多传统方法难以处理的问题。随着研究的不断深入,Transformer模型在各个领域的应用前景愈加广阔。无论是在NLP、计算机视觉还是其他领域,Transformer模型都展现出了其无与伦比的优势和潜力。未来,随着技术的进一步发展,我们可以期待Transformer在更多领域带来创新和突破。

闪电发卡ChatGPT产品推荐:ChatGPT独享账号

ChatGPT Plus 4.0独享共享账号购买代充

ChatGPT APIKey 3.5和4.0购买充值(直连+转发)

ChatGPT Plus国内镜像(逆向版)

ChatGPT国内版(AIChat)

客服微信:1、chatgptpf 2、chatgptgm 3、businesstalent